-

서포트 벡터 머신 (Linear SVM / Non-linear SVM)아가개발자/머신러닝 2020. 12. 4. 18:18

Hard Margin SVM & Soft Margin SVM

- Hard Margin SVM : 선형 분리가 가능한 문제

- Soft Margin SVM : 선형 분리가 불가능한 문제 → 에러를 허용

sorce: https://medium.com/@ankitnitjsr13/math-behind-svm-support-vector-machine-864e58977fdb 위의 오른쪽 사진과 같이 soft margin SVM은 학습 데이터의 에러가 0이 되도록 완벽하게 나누는 것이 불가능하다.

따라서, Soft Margin SVM의 목적은 에러를 허용하면서 margin을 최대화 하는 것이다.

Original Problem SVM의 원래 식의 C를 통하여 에러의 허용 정도를 조절 할 수 있다.

C가 커지면 에러를 상대적으로 허용하지 않음(Overfitting) → margin 작아짐

C가 작아지면 에러를 상대적으로 허용함(Underfitting) → margin 커짐

Soft Margin SVM의 최종식 Nonlinear SVM

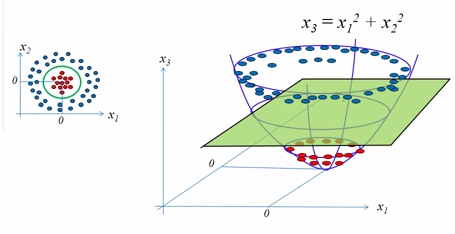

source: https://medium.com/@LSchultebraucks/introduction-to-support-vector-machines-9f8161ae2fcb - 데이터를 선형으로 분류하기 위해 차원을 높이는 방법을 사용함

source: https://www.youtube.com/watch?v=ffF8UnbheLk - feature map을 통해 차원을 높임

- 커널: feature map의 내적

'아가개발자 > 머신러닝' 카테고리의 다른 글

군집화 (Clustering) (0) 2020.12.06 서포트 벡터 머신(SVM) 실습 (0) 2020.12.05 서포트 벡터 머신 (SVM) (0) 2020.12.03 의사결정나무 - Decision Tree (0) 2020.10.20 선형 판별 분석(LDA) 실습 (0) 2020.10.14